Veijo Hänninen

Vaihtoehtona neuroverkot

Kvanttitietotekniikan ja fotonisen laskennan ollessa vielä enemmän tutkimusvaiheessa keinotekoiset ja vähemmän keinotekoiset neuroverkot ovat jo osoittaneet olevansa varteenotettava vaihtoehto.

Viime vuosina syväoppiminen on mullistanut koneoppimisen alan, erityisesti tietokonenäön osalta. Kyseisessä lähestymistavassa opetetaan syvää eli monikerroksista keinotekoista neuroverkkoa (ANN), useimmiten hallitulla tavalla takaisinetenemistä hyödyntäen. Valtavia määriä koulutusesimerkkejä tarvitaan, mutta tuloksena oleva luokittelutarkkuus on todella vaikuttava, toisinaan jopa ihmistä parempi.

Neuromorfisien arkkitehtuurien vakiintunein puoli ovatkin keinotekoiset neuroverkot eli ANN:t, joissa informaatio välitetään ja esitetään reaalilukujen, ei aivotoimintaa matkivan piikittävän toimintatavan kautta.

Piikittävät neuroverkot

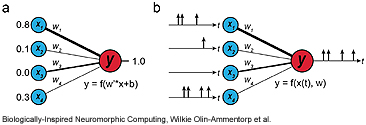

Keinotekoiset (ANN) ja piikittelevät neuroverkot (SNN) eroavat toisistaan sen suhteen kuinka syvällisesti niissä pyritään hyödyntämään aivojen todellista neuronikäyttäytymistä.

ANN:t toimivat numeerisesti eivätkä välttämättä muutu ajan myötä (a). SNN:t välittävät viestejä vain piikkien kautta ja ne ovat luonteeltaan pohjimmiltaan ajallisia (b)

ANN:t toimivat numeerisesti eivätkä välttämättä muutu ajan myötä (a). SNN:t välittävät viestejä vain piikkien kautta ja ne ovat luonteeltaan pohjimmiltaan ajallisia (b)

Piikittävän toimintatavan myötä syntyy etua erityisesti toteutus- ja käyttökustannusten osalta.

Keinotekoisissa jokainen neuroni laskee ja summaa aina ja sen on aina välitettävä arvonsa, vaikka arvo olisi "nolla". Jokainen viesti on myös esitettävä liukuluvulla, mikä johtaa suuriin muisti- ja laskentavaatimuksiin.

Sitä vastoin piikitys on yksittäinen, välitön, 1-bittinen viesti, joka välitetään vain tarvittaessa. Tämä johtaa perustavanlaatuisiin eroihin, jotka suosivat piikittävää keinotekoisten sijaan.

Kaikki SNN-verkkojen neuronien välillä välitetyt viestit koodataan sarjalla lähes hetkellisiä piikkejä. Vaikka niillä saattaa olla jatkuvia synapsiarvoja ja sisäistä potentiaalia, ajallisten piikkien käyttö viestinnässä erottaa pohjimmiltaan SNN:t ANN:ista.

Vähäisemmällä käyttöteholla

Piikittävät neuroverkot (SNN:t) ovat biologisesti realistisempia kuin ANN-verkot ja ne ovat luultavasti ainoa käyttökelpoinen vaihtoehto, jos halutaan ymmärtää, miksi aivot laskevat niin pienellä käyttöteholla.

Biologisten neuronien piikitykset ovat harvoja ajassa ja tilassa sekä tapahtumien ohjaamia. Yhdistettynä biologisesti uskottaviin paikallisiin oppimissääntöihin tämä helpottaa vähän virtaa vaativien neuromorfisten piirirakenteiden rakentamista SNN:lle.

Syvien SNN-verkkojen kouluttaminen on kuitenkin edelleen haaste. Piikittävien neuronien siirtotoiminto on yleensä erottumaton, mikä estää takaisinetenemisen (backpropagation) käytön harjoitteluun. Mutta tutkijat yrittävät parhaillaan ylittää tämänkin esteen.

Piikittäviä neuromorfisia laskentajärjestelmiä (SNN) voidaan käyttää suurten digitaalisten datamäärien tallentamiseen ja käsittelyyn paljon pienemmällä käyttötehon kulutuksella kuin perinteisillä prosessoreilla toimittaessa. Siten niiden mahdollisten tulevaisuuden sovellusten joukossa tärkeä markkinarako on ohjauksen siirtäminen datakeskuksista reunalaitteisiin.

Memristori muistaa

Memristoriin perustuva neuromorfinen laskenta voi ylittää perinteisten von Neumannin laskenta-arkkitehtuurien rajoitukset – joissa dataa siirrellään erillisen muisti- ja prosessointiyksiköiden välillä – ja siten parantaa syvien neuroverkkojen suorituskykyä.

Tämä vaatii kuitenkin tarkan suorituskykyisen synaptisen piirirakenteen ja memristorit kärsivät tyypillisesti huonosta tuotosta ja rajallisesta määrästä luotettavia johtavuustiloja. Tutkijat ovat kehitelleet erilaisia memristoreita muun muassa grafeeniin ja perovskiittiin tukeutuen.

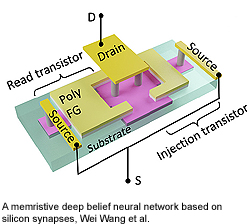

Äskettäin kansainväliset tutkijat raportoivat kelluvan portin memristiivisistä synaptisista piirirakenteista, jotka on valmistettu kaupallisessa CMOS-prosessissa. Nämä piisynapsit tarjoavat analogisen virittävyyden, hyvän käyttökestävyyden, pitkän muistisäilytysajan, ennustettavan syklin heikkenemisen, kohtuullisen laitteiden välisen vaihtelun ja korkean tuottosaannon.

Äskettäin kansainväliset tutkijat raportoivat kelluvan portin memristiivisistä synaptisista piirirakenteista, jotka on valmistettu kaupallisessa CMOS-prosessissa. Nämä piisynapsit tarjoavat analogisen virittävyyden, hyvän käyttökestävyyden, pitkän muistisäilytysajan, ennustettavan syklin heikkenemisen, kohtuullisen laitteiden välisen vaihtelun ja korkean tuottosaannon.

Ne tarjoavat myös kaksi kertaluokkaa paremman energiatehokkuuden kertomis- ja akkumulointitoimintoihin kuin grafiikkaprosessoinnin yksiköt (GPU).

Piireillään tutkijat loivat memristiivisen syvän uskomuksen neuroverkon, joka koostuu kolmesta memristiivisesti rajoittuneesta Boltzmann-koneesta.

Syvä uskomusverkko (deep belief network DBN) on generatiivinen graafinen syvän neuroverkon luokka, joka koostuu useista kerroksista piileviä muuttujia ja yhteyksiä kerrosten välillä, mutta ei kunkin kerroksen yksiköiden välillä.

Aikoinaan havainto, että DBN:itä voidaan kouluttaa ahneesti, kerros kerrallaan, johti yhteen ensimmäisistä tehokkaista syväoppimisalgoritmeista.

Ahneus viittaa tapaan tehdä optimaalisia valintoja ensin kussakin vaiheessa. Ne eivät välttämättä ole laajemmin optimaalisia mutta nopeuttavat kuitenkin kokonaisopmimaalisuuden saavuttamista.

Laskentaa muistissa

Lisäksi neuroverkkojen alalla kehitellään muistissa tapahtuvan laskennan (In-memory-prosessing) ratkaisuja, joissa prosessoidaan dataa joka on tallennettu muistipiireihin.

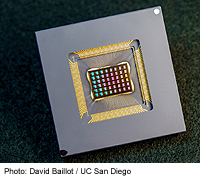

Kalifornian San Diegon yliopiston vetämä kansainvälinen tutkijaryhmä on suunnitellut ja rakentanut sirun, joka suorittaa laskelmia suoraan muistissa ja pystyy suorittamaan monenlaisia tekoälysovelluksia – kaikki vain murto-osalla yleiskäyttöisen tekoälylaskennan alustojen kuluttamasta energiasta.

Kalifornian San Diegon yliopiston vetämä kansainvälinen tutkijaryhmä on suunnitellut ja rakentanut sirun, joka suorittaa laskelmia suoraan muistissa ja pystyy suorittamaan monenlaisia tekoälysovelluksia – kaikki vain murto-osalla yleiskäyttöisen tekoälylaskennan alustojen kuluttamasta energiasta.

Äskettäin esitelty neuromorfinen NeuRRAM -siru tuo tekoälyn askeleen lähemmäksi toimimista useissa reunalaitteissa, jotka on irrotettu pilvestä. Kohteessaan ne voivat ajaa kehittyneitä kognitiivisia tehtäviä missä ja milloin tahansa ilman verkkoyhteyttä keskitettyyn palvelimeen.

NeuRRAM-siru ei ole vain kaksi kertaa energiatehokkaampi kuin huippuluokan "compute-in-memory" -sirut, innovatiivinen hybridisirujen luokka, joka suorittaa laskelmia muistissa, vaan se tuottaa myös tuloksia, jotka ovat yhtä tarkkoja kuin perinteisillä digitaalisilla siruilla. Perinteiset tekoälyalustat ovat paljon kookkaampia ja tyypillisesti rajoittuvat käyttämään suuria pilvessä toimivia datapalvelimia.

Lisäksi NeuRRAM-siru on erittäin monipuolinen ja tukee monia erilaisia neuroverkkomalleja ja -arkkitehtuureja. Tämän seurauksena sirua voidaan käyttää moniin erilaisiin sovelluksiin, mukaan lukien kuvantunnistus ja rekonstruointi sekä äänentunnistus.

Avain NeuRRAMin energiatehokkuuteen on innovatiivinen menetelmä muistin tuottamiseen. Perinteiset lähestymistavat käyttävät jännitettä tulona ja mittaavat virtaa tuloksena. Mutta tämä vaatii monimutkaisempia ja enemmän tehoa kuluttavia piirirakenteita.

NeuRRAM on neuronipiiri, joka tunnistaa jännitteen ja suorittaa analogia-digitaalimuunnoksen energiatehokkaalla tavalla. Tämä jännitetilan tunnistus voi aktivoida kaikki RRAM-ryhmän rivit ja sarakkeet yhdessä laskentajaksossa, mikä mahdollistaa suuremman rinnakkaisuuden.

Neuroverkkototeutuksia joustavasti

Kiinalaisen Sun Yat-Sen Universityn tutkijat raportoivat joulukuussa transistorimallista, jonka elektrolyyttisen portin ionidynaamista kapasitanssia ohjaamalla transistorin toimintatiloja voidaan vaihtaa, mikä tarjoaa joustavia neuroverkkototeutuksia.

Jo aiemmin on osoitettu, että elektrolyyttisen portin transistorit voivat toimia kytkentäelementteinä, keinotekoisina synapseina ja muistijärjestelminä.

Sun Yat-Senin tutkivat ovat nyt osoittaneet, että näiden monitoimitransistoreiden avulla voidaan todella luoda neuroverkkoja, joiden toimintoja voidaan vieläpä vaihtaa perinteisten keinotekoisten neuroverkkojen, toistuvien neuroverkkojen (RNN) ja piikittävien neuroverkkojen välillä.

Toistuva neuroverkko (recurrent neural networks RNN) on keinotekoisten neuroverkkojen luokka, jossa solmujen väliset yhteydet voivat luoda jakson, jolloin joidenkin solmujen lähtö voi vaikuttaa saman solmun seuraavaan syötteeseen. Näin se osoittaa ajallista dynaamista käyttäytymistä.

Feedforward -neuroverkoista johdetut RNN:t voivat käyttää sisäistä tilaansa (muistia) prosessoidakseen muuttuvan pituisia syötteitä. Tämä tekee niistä soveltuvia sellaisiin tehtäviin kuin käsin kirjoittamisen tai puheen tunnistukseen. Toistuvat neuroverkot ovat teoriassa myös Turing-täydellisiä eli ne voivat simuloida Turing-konetta ja ajaa mielivaltaisia ohjelmia prosessoidakseen mielivaltaisten syötteiden sarjoja.

Keinotekoinen neuroni

Neuromorfisessa laskennassa biologisten neuronien emulointi on keskeinen komponentti.

Erilaisia memristoripohjaisia neuroneja pidetään kilpailukykyisempänä lähestymistapana tulevaisuudelle niiden lupaavan biologisen uskottavuuden ja tiheyden vuoksi. Niihin liittyy kuitenkin edelleen monia haasteita, kuten rajallinen luotettavuus, integroinnilta tilaa vievät kondensaattorit tai lisäpiirit nollausta varten.

Kiinalaisen Fudanin yliopiston tutkijat ovat toteuttaneet kompakteja keinotekoisia neurosoluja, jotka perustuvat Hf0,2Zr0,8O2 antiferrosähköisiin transistoreihin.

Antiferrosähköisen transistorin sisäinen polarisaation kertymävaikutus toteuttaa neurokalvon integrointiominaisuuden ja näin vältetään ulkoisten kondensaattoreiden käyttöä ja säästetään sirualuetta.

Antiferrosähköisen transistorin spontaani depolarisaatiovaikutus jäljittelee puolestaan neurosolujen vuotavaa käyttäytymistä ja säästää neuropiirien laitteiston kuormitusta poistamalla ulkoiset nollauspiirit.

Lisäksi antiferrosähköisellä transistorineuronilla on alhainen energiankulutus, erinomainen kestävyys ja hyvä vakaus. Tutkijoiden mukaan tämä työ tarjoaa kilpailukykyisemmän lähestymistavan erittäin tehokkaiden neuromorfisten laitteistojärjestelmien rakentamiseen.

Soveltuu vaikka mihin

Neuroverkkojen sovellukset valtaavat yhä laajempia aloja mutta ovat yleensä varsin erikoistuneita ratkaisuja. Muun muassa robottitekniikan odotetaan tehostuvan sille sopivien neuroverkkototeutusten avulla.

Argonne National Laboratoryn tutkijat käyttävät tekoälyä ja robottiavusteisia laboratoriota nopeuttamaan parempien akkumateriaalien etsintää. Erityisesti kiinteän olomuodon elektrolyytti on tutkijoiden mielessä

Automaattinen löytö voi dramaattisesti lisätä tutkimuksemme tehoa, koska koneet voivat työskennellä kellon ympäri ja vähentää inhimillisten virheiden mahdollisuutta", tutkijat kertovat.

Tietoliikenteessä ei heti arvaisi tarvittavan neuroverkkotekniikkaa. Princeton Lightwave Labin ja NEC Laboratory American tutkijat ovat kuitenkin äskettäin luoneet neuroverkkolaitteiston, joka voisi kompensoida tietoliikennekuitujen epälineaarisuuden haitallisia vaikutuksia vähemmällä tehonkäytöllä kuin DSP-tekniikka, jolla se nykyään tehdään. Menetelmä hyödyntää fotonista neuroverkkoa, joka perustuu aallonpituusjakoiseen multipleksointiin (WDM). Se on rakennettu piille fotonialustaan, joka on yhteensopiva CMOS-teknologian kanssa.

Princetonin yliopistossa simuloitiin puolestaan jään muodostumisen alkuvaiheita käyttämällä tekoälyä (AI) ratkaisemaan yhtälöitä, jotka ohjaavat yksittäisten atomien ja molekyylien kvanttikäyttäytymistä.

Syvien neuroverkkojen avulla saavutettiin tarkkuustaso, jota pidettiin aiemmin saavuttamattomana sen vaatiman laskentatehon vuoksi. Uusin menetelmin ajettiin jopa 300 000 atomin simulaatioita huomattavasti pienemmällä laskentateholla, paljon pidempään kuin aiemmin oli mahdollista.

Tammikuu 2023